IA al lavoro - Quando le macchine diventeranno pensanti?

di Bruno Forti, psichiatra

Una domanda che ricorre spesso, a fronte degli sbalorditivi progressi dell’Intelligenza Artificiale (IA), è se e quando le macchine riusciranno ad essere consapevoli. Porci questa domanda ci porta a confrontare tra loro menti artificiali e menti naturali.

È un confronto che ci costringe a ripensare e a cercare di definire concetti che riguardano le nostre menti ma che spesso sono prescientifici e mal definiti, e che per essere utilizzati nell’ambito dell’IA dovrebbero possedere quantomeno una definizione operazionale.

Alcuni di essi, come l’intelligenza, l’intuito, la comprensione o il senso comune, si riferiscono quantomeno a qualcosa che facciamo e che in qualche modo, anche se in maniera approssimativa, può essere osservata dall’esterno.

Altri, come quelli relativi al sentire, al provare qualcosa sono ancora più sfuggenti, perché sono osservabili e definibili solo in prima persona.

Storicamente, una delle distinzioni più importanti è quella tra IA debole e IA forte. Adesso si preferisce parlare di IA ristretta e IA generale.

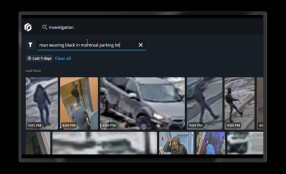

L’IA ristretta ha raggiunto incredibili risultati in campi specifici dell’intelligenza umana, come gli scacchi, il gioco del go, la traduzione, il riconoscimento del parlato o di oggetti visivi. Tali campi riguardano prevalentemente ambiti chiusi con regole predefinite.

L’IA generale prevede la capacità di risolvere più problemi, di connettere tra loro ambiti diversi, di generalizzare ad altri ambiti le conoscenze acquisite in un ambito.

Con il classico machine learning, un computer che gioca a scacchi deve iniziare da zero per imparare la dama. Oggi questo aspetto è meno vincolante e sembra che l’obiettivo di una IA generale non sia poi così lontano.

Ma l’IA generale non è la stessa cosa dell'IA forte, che mira a creare macchine intelligenti che siano indistinguibili dalla mente umana, non solo nei risultati. L’IA forte era originariamente intesa nel senso di utilizzare i medesimi processi del cervello e di poter essere assimilata in tutto ad una mente umana. Come vedremo, questa differenza non è irrilevante.

Sono state individuate tre fasi dell’IA: machine learning, machine intelligence e machine consciousness. Se gli ultimi decenni hanno visto lo sviluppo prima della capacità di apprendere da parte delle macchine e successivamente la crescita della loro “intelligenza”, la coscienza viene collocata in uno stadio che appare ancora al di là delle possibilità attuali delle macchine.

Nel 2000 Joelle Proust affermava che “con coscienza della macchina si intende una macchina non biologica, creata dall'uomo, che è consapevole della propria esistenza e può pensare come se avesse una mente”.

Ci si chiede quindi quando i computer saranno coscienti o consapevoli.

La consapevolezza, nonostante venga spesso considerata un sinonimo di coscienza, è un concetto meno sfuggente di coscienza se la concepiamo nel senso di metarappresentazione, di “riflessione” su ciò che si fa, di monitoraggio delle proprie azioni e del proprio stato in relazione al mondo.

Preferisco quindi utilizzare il termine “consapevolezza” piuttosto che “coscienza”. È soprattutto ad essa che ci si riferisce quando ci si chiede se le macchine diventeranno coscienti. Inoltre, è più facilmente osservabile dal di fuori.

Certo, potremmo dire che la sofferenza è osservabile in quanto ci viene riferita, o può essere desunta da un’espressione del viso. Ma si tratta sempre di qualcosa che corrisponde, o non corrisponde, a ciò che accade dentro, allo stato interno di un organismo.

Osservare l’autoconsapevolezza di una persona può significare invece osservare i suoi pensieri e i suoi processi mentali nel loro svolgersi.

Secondo Proust ci sono almeno tre tipi di consapevolezza:

· Consapevolezza dell'agente: quando si è consapevoli di una certa azione che si è eseguita.

· Consapevolezza dell'obiettivo: il motivo che guida l'azione che si intraprende.

· Consapevolezza sensorimotoria: la conoscenza o il riconoscimento che si ha quando ci si impegna fisicamente in un'azione.

Tuttavia, questa definizione, alla pari di altre simili, è mancante di un aspetto indispensabile per parlare di consapevolezza nel senso umano del termine, cioè la consapevolezza sentita. Possiamo quindi distinguere tra consapevolezza in senso lato del proprio agire, che comprende anche i propri obiettivi, consapevolezza sensorimotoria e consapevolezza sentita.

La prima forma di consapevolezza è quella che allo stato attuale appare maggiormente realizzata. La ritroviamo nelle cosiddette chatbot, i programmi progettati per simulare una conversazione con un essere umano. I più avanzati di essi sono i Large Language Model (LLM). Una macchina di questo tipo può essere consapevole di quello che fa nel senso cognitivo del termine, cioè dei suoi “pensieri”, dei suoi obiettivi e del suo stato. È una sorta di automonitoraggio sulle proprie azioni, che nel caso dei LLM sono azioni cognitive.

C’è poi la consapevolezza relativa all’essere, che può andare da forme banali di identità inserite dal programmatore a risposte complesse e non scontate che i sistemi di conversazione più avanzati talora forniscono lasciandoci stupefatti. Per semplicità non affronto qui questa forma di consapevolezza. Tuttavia, va detto che l’identità, l’essere, è legato, almeno in parte, ad azioni e obiettivi di carattere generale. Ad esempio, essere ha a che fare con il ruolo di una macchina, che è quello di assisterci in compiti di natura cognitiva.

Non necessariamente un computer “sa” quello che fa, come del resto accade a noi. Non sa ad esempio come riesce a riconoscere una singola faccia, se non raccontandoci il procedimento generale.

Qualche decennio fa nella letteratura cognitivista si usavano i termini esplicito e implicito per riferirsi a ciò che è cosciente e a ciò che non lo è. Questa distinzione non risolveva in alcun modo il problema della coscienza, forniva solo una distinzione formale.

Possiamo però applicare questa formula a un LLM chiamando esplicito semplicemente ciò che dichiara, che è in grado di riferirci nella conversazione che sta avendo con noi. In questo senso possiamo dire che i computer hanno delle forme di consapevolezza, che in qualche misura “sanno”, si rendono conto di quello che fanno.

Nell’uso corrente è una consapevolezza reattiva, on demand, non c’è una riflessione spontanea, un ripensamento su ciò che viene fatto. Ma questo, almeno in parte, dipende dalla sua programmazione.

Quindi la consapevolezza nel primo significato del termine esiste, almeno nel senso più semplice del termine. Non è simulazione di consapevolezza, potremmo chiamarla una forma funzionale di consapevolezza.

Una seconda forma di consapevolezza è quella sensorimotoria. Noi non siamo menti disconnesse dall’ambiente che ci circonda e disincarnate da quel corpo che è il fondamento del nostro essere. Il nostro essere persona che sa, pensa e decide avviene in un corpo che interagisce con gli oggetti e con le persone con cui viviamo. Siamo consapevoli di un corpo che agisce nel mondo. È la consapevolezza che potrebbe avere non un computer ma un automa.

C’è però una differenza fondamentale tra esseri viventi e macchine pensanti. Gli animali, prima ancora di possedere una mente, sono corpi viventi che agiscono nel mondo e sono attrezzati per sopravvivere e garantire la trasmissione della specie. Ad un certo punto sono divenuti esseri senzienti che provano piacere, dolore, e presumibilmente emozioni, esibendo un comportamento adattativo intelligente e flessibile. Successivamente hanno sviluppato forme di pensiero non verbali e solo nell’uomo un ragionamento basato sul linguaggio simbolico.

Al contrario, il computer in qualche modo inizia dall’alto. Esibisce una cognizione basata sulla logica, sul linguaggio verbale, sulla manipolazione di simboli prima ancora che di oggetti, ma non possiede un corpo.

A differenza che per gli organismi viventi che nascono con un corpo e poi sviluppano capacità di pensare progressivamente più simili a quelle degli umani, la consapevolezza sensorimotoria appare molto più complicata in un’entità come un computer, che nasce disincarnata. La sua realizzazione nella complessità di un automa similumano che interagisce col mondo sarebbe molto più difficile ma, in linea teorica, non impossibile.

Naturalmente la consapevolezza non può essere rivolta a stati o ad azioni rigidamente predeterminate, altrimenti dovremmo assegnare l’autoconsapevolezza anche ad un’automobile che “si rende conto” di essere in riserva. La consapevolezza include la creazione e la sperimentazione di modelli alternativi di ciascun processo basati sulle informazioni ricevute, ed è utile anche per fare previsioni. Creare modelli consapevoli richiede flessibilità, capacità di modellare il mondo fisico, i propri stati e processi interni ed altre entità consapevoli.

Alcuni distinguono tra consapevolezza cosciente e consapevolezza non cosciente, attribuendo ad esempio a quest’ultima i movimenti che facciamo quando camminiamo e di cui non necessariamente ci rendiamo conto. Ma in questo modo si rischia di attribuire in toto alla consapevolezza i meccanismi sensomotori di controllo e di regolazione.

C’è una terza forma di consapevolezza, solo apparentemente simile alla seconda.

Una cosa è recepire degli stimoli, una cosa è sentirli. Un automa che raccoglie un oggetto può sapere quanto grande è, che forma ha, quale è la sua consistenza, se è caldo o freddo. Ma non sente il calore, la grandezza, la forma, la consistenza dell’oggetto.

La consapevolezza di noi umani è legata al nostro essere senzienti. Noi siamo esseri che sentono, che hanno sensazioni; che provano qualcosa, che hanno emozioni, sentimenti. Naturalmente, essere consapevoli di sentire è più del sentire in sé, ma per essere consapevoli di sentire bisogna sentire. In noi la consapevolezza dell’agire, la consapevolezza sensorimotoria e la consapevolezza sentita sono unite. La nostra consapevolezza sensorimotoria è legata al sentire, anche se non sempre. Molte nostre reazioni o regolazioni sensomotorie avvengono al di fuori della coscienza, pensiamo ad esempio alla coordinazione e al mantenimento dell’equilibrio. Il pensare in noi è legato al sentire e a un corpo che pensa. Se penso, “sento” il mio pensiero. Sento di esistere come essere pensante. Cartesio non avrebbe formulato il cogito se avesse pensato come pensa un computer, se non avesse “sentito” di pensare.

La questione relativa a quando i computer diverranno consapevoli è quindi mal posta perché la consapevolezza nel senso umano del termine presuppone sia il sentire, il provare qualcosa, sia la consapevolezza nel senso di automonitoraggio. Se sentire di per sé non garantisce la consapevolezza, noi non possiamo che essere consapevoli a partire dalla consapevolezza, sentita, di sentire. Di sentire il mondo esterno, di sentire il nostro corpo che reagisce agli stimoli esterni ed interni. Di sentire le nostre emozioni, i nostri ricordi, le nostre fantasie.Ma anche i nostri pensieri, i nostri ragionamenti più complessi e astratti. La nostra stessa autoconsapevolezza non è altro che un sentire. Un sentire di sentire, a più livelli, ma che non esclude mai l’aspetto del sentire.

Non si tratta quindi di un problema collocato all’apice del funzionamento della macchina, che potrà essere colmato con degli sviluppi computazionali più complessi e sofisticati. È un problema che è tale a livelli elevati ma che si pone fin dai processi più semplici di una macchina sensorimotoria, in cui stimoli che per noi sono odori, colori, freddo, dolore non dovrebbero essere solo recepiti ma anche sentiti.

In conclusione, se consapevolezza e autoconsapevolezza umane sono fatte di sentire, se la consapevolezza è una consapevolezza sentita, non ha senso cercare la soluzione in dispositivi sempre più elaborati, tali da poter monitorare in maniera flessibile le proprie azioni e dal poter conoscere i propri stati e i propri obiettivi. Queste macchine, tuttalpiù, potranno simulare il sentire, come in parte già fanno, ma senza sentire e provare nulla. In certi casi potranno recepire determinati aspetti del mondo, cioè possedere un equivalente funzionale del sentire, che però non è la stessa cosa del sentire.

Non si tratta di una distinzione accademica, priva di conseguenze. Se le macchine fossero in grado di sentire, di provare, di avere sensazioni piacevoli o dolorose, delle emozioni e dei sentimenti, ci dovremmo porre immediatamente dei problemi etici non di poco conto. In maniera simile a come ce li poniamo per organismi come le aragoste, relativamente evoluti ma privi di ragionamento, linguaggio e autocoscienza.

Tuttavia, Il sentire allo stato attuale appare estremamente arduo da realizzare, come del resto lo è rispetto a ciò che conosciamo del cervello umano. Sicuramente non potrà essere ottenuto con macchine più potenti, più complesse, più sofisticate.

In caso di riproduzione citare la fonte